还是原装Transformer好!北大清华团队同时揭示Mamba等推理短板

发布时间:2024-10-22 08:18

发布时间:2024-10-22 08:18 发布者:网络

发布者:网络 浏览次数:

浏览次数:

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

北京大学的工作来自智能学院王立威、贺笛老师课题组,发表于icml 2025。作者包括北京大学图灵班本科生杨铠;苏黎世联邦理工学院硕士生jan ackermann;北京大学智能学院博士生何震宇、冯古豪、张博航;纽约大学博士生冯韫禛;北京智源研究院研究员叶启威;清华大学的工作来自于明年即将入职清华大学交叉信息院做助理教授、目前在加州大学伯克利分校 simons institute 做博士后的吕凯风研究员。作者包括斯坦福在读一年级博士温凯越;清华大学姚班本科生党星宇。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

论文 1:Do Efficient Transformers Really S*e Computation? (发表于 ICML 2025) 论文链接:https://arxiv.org/abs/2402.13934

论文 2:RNNs are not Transformers (Yet): The Key Bottleneck on In-context Retrieval 论文链接:https://arxiv.org/abs/2402.18510

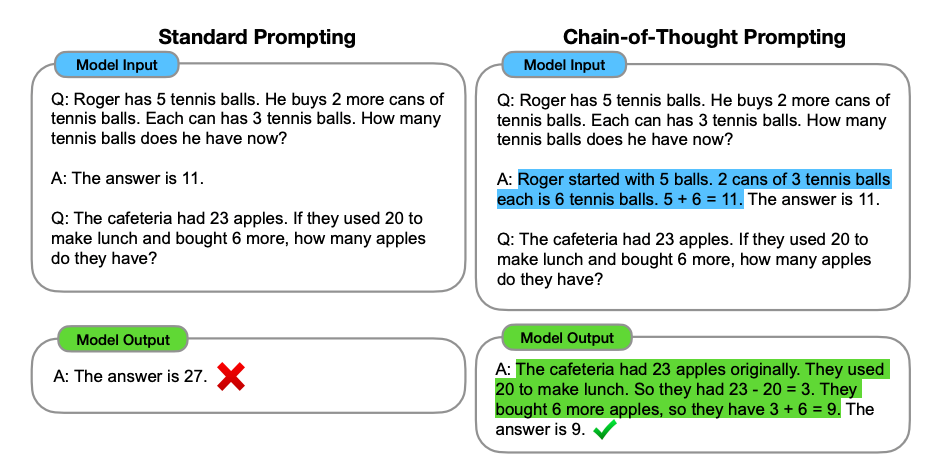

r 可以不使用 CoT 解决检索、关联回忆、计数等问题,并使用 O (n) 长度的 CoT 正确判断一张图是否为树。这些结果表明类 RNN 的结构使用思维链获得的能力,距离 Transformer 仍有巨大差距。

r 可以不使用 CoT 解决检索、关联回忆、计数等问题,并使用 O (n) 长度的 CoT 正确判断一张图是否为树。这些结果表明类 RNN 的结构使用思维链获得的能力,距离 Transformer 仍有巨大差距。

Yaara

Yaara

使用AI生成一流的文案广告,电子邮件,网站,列表,博客,故事和更多…

95

查看详情

95

查看详情

以上就是还是原装Transformer好!北大清华团队同时揭示Mamba等推理短板的详细内容,更多请关注其它相关文章!

# 产业

# cot

# 邮箱

# type

# 短板

# 清华

# 神技

# 清华大学

# 北京大学

# 北大

# 南极

# 华纳

# 这一

# 长程

# 软文推广在那些网站

# seo重要程度排序

# 西安关键词排名优化商家

# 中牟抖音关键词排名公司

# 网站seo排名-选择u

# 惠城seo推广优化

# 天津关键词自动排名

# 怎样做好营销和产品推广

# 包头网络营销推广seo

# seo工作进度表