【NCDA】手把手教你用AI玩转图像

发布时间:2025-07-17 10:07

发布时间:2025-07-17 10:07 发布者:网络

发布者:网络 浏览次数:

浏览次数:未来设计师·全国高校数字艺术设计大赛始于2012年,每年一届,已入选中国高等教育学会发布的《全国普通高校学科竞赛排行榜》和《全国普通高校教师教学竞赛项目》,是高校教育教学改革和创新人才培养的重要竞赛项目之一。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

第十届未来设计师·全国高校数字艺术设计大赛

未来设计师·全国高校数字艺术设计大赛始于2012年,每年一届,已入选中国高等教育学会发布的《全国普通高校学科竞赛排行榜》和《全国普通高校教师教学竞赛项目》,是高校教育教学改革和创新人才培养的重要竞赛项目之一。

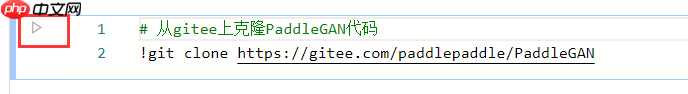

全文中遇到代码的地方,鼠标移动到代码框

点击左侧的运行即可

安装环境

In [ ]下面代码运行时间大概需要 8 秒左右,请耐心等候

!pip install paddlehub --upgrade

图像风格迁移

人工智能模型通过学习某一类图像(比如宫崎骏的所有漫画作品)后,再输入一张新的图片,模型就能根据之前学习到的参数对输入图片进行重新绘制,生成训练数据集对应的风格。PaddleHub目前已封装了三个不同风格漫画的模型,分别是宫崎骏风格、今敏风格和新海诚风格。

宫崎骏风格

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。

output_dir: 输出文件夹,即生成图片保存的路径。

其余参数保持不变即可。

In [2]下面代码运行时间大概需要 1 分钟左右,请耐心等候

import paddlehub as hubimport cv2from displayimg import imshow

%matplotlib inline

img = "./work/fengge.jpg" # <- 这里替换成原图的路径model = hub.Module(name="animegan_v2_hayao_99")

result = model.style_transfer(

images = [cv2.imread(img)],

output_dir = './output/gongqijun', # <- 运行完成后在左侧栏的output文件夹下面的gongqijun文件夹可以找得到生成后的图像文件

visualization = True

)

imshow(img, result[0])[2025-03-29 22:50:10,223] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the object W0329 22:50:10.226275 2454 analysis_predictor.cc:1350] Deprecated. Please use CreatePredictor instead.

<Figure size 840x700 with 2 Axes>

今敏风格

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。

output_dir: 输出文件夹,即生成图片保存的路径。

其余参数保持不变即可。

In [3]下面代码运行时间大概需要 1 分钟左右,请耐心等候

import paddlehub as hubimport cv2from displayimg import imshow

%matplotlib inline

img = './work/fengge.jpg' # <- 这里替换成原图的路径model = hub.Module(name="animegan_v2_paprika_98")

result = model.style_transfer(

images=[cv2.imread(img)],

output_dir = './output/jinmin', # <- 运行完成后在左侧栏的output文件夹下面的jinmin文件夹可以找得到生成后的图像文件

visualization = True

)

imshow(img, result[0])[2025-03-29 22:51:07,384] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the object

<Figure size 840x700 with 2 Axes>

新海诚风格

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。

output_dir: 输出文件夹,即生成图片保存的路径。

其余参数保持不变即可。

In [4]下面代码运行时间大概需要 1 分钟左右,请耐心等候

import paddlehub as hubimport cv2from displayimg import imshow

%matplotlib inline

img = './work/fengge.jpg' # <- 这里替换成原图的路径model = hub.Module(name="animegan_v2_shinkai_53")

result = model.style_transfer(

images=[cv2.imread(img)],

output_dir = './output/xinhaicheng', # <- 运行完成后在左侧栏的output文件夹下面的xinhaicheng文件夹可以找得到生成后的图像文件

visualization = True

)

imshow(img, result[0])[2025-03-29 22:52:03,873] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the object

<Figure size 840x700 with 2 Axes>

图片转油画

Paint Transformer是百度、南京大学提出的首个基于前馈笔触预测来进行快速油画渲染的算法,可以快速将一张图片变成一幅充满质感的油画!飞桨版本由飞桨开发者技术专家AP-Kai转换和封装。

美图云修

美图云修

商业级AI影像处理工具

50

查看详情

50

查看详情

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。

其余参数保持不变即可。

In [2]下面代码运行时间大概需要 12 秒左右,请耐心等候

%cd paintmaster/import cv2from PIL import Imagefrom displayimg import imshowfrom inference.inference import main as infer_main %matplotlib inline img = "/home/aistudio/work/fengge.jpg" # <- 这里替换成原图的路径result = infer_main(img, "inference/paint_best.pdparams", '../output', resize_h=1024, resize_w=1024) imshow(img, result) %cd /home/aistudio

/home/aistudio/paintmaster

<Figure size 840x700 with 2 Axes>

/home/aistudio

黑白图片上色

老照片/黑白照记录着曾经的岁月,承载着美好的回忆与厚重的历史。但由于年代久远,旧的图像素材往往存在模糊、缺色等问题。我们可以通过人工智能模型,让老照片重现往日光彩。

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。

output_path: 输出文件夹,即生成图片保存的路径。

其余参数保持不变即可。

In [6]下面代码运行时间大概需要 1 分钟左右,请耐心等候

import paddlehub as hubfrom displayimg import imshow

%matplotlib inline

img = 'work/heibai.jpg' # <- 这里替换成原图的路径model = hub.Module(name='deoldify',

output_path="./output/") # <- 运行完成后在左侧栏的output文件夹下面的DeOldify文件夹可以找得到生成后的图像文件result = model.predict(img)

imshow(img, result[0])load pretrained checkpoint success

<Figure size 840x700 with 2 Axes>

人像抠图

21世纪了,还在傻傻地用Photoshop的魔棒低效率抠图吗?试下下面这个神器吧,不仅能一步就把人像从复杂的背景中抠出来,还能顺便换个背景。

抠人像

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。

output_dir: 输出文件夹,即生成图片保存的路径。

其余参数保持不变即可。

In [7]下面代码运行时间大概需要 15 秒左右,请耐心等候

import paddlehub as hubimport cv2from displayimg import imshow

%matplotlib inline

img = "work/ren.jpg" # <- 这里替换成原图的路径human_seg = hub.Module(name="deeplabv3p_xception65_humanseg")

result = human_seg.segmentation(

images = [cv2.imread(img)],

output_dir = './output/humanseg', # <- 运行完成后在左侧栏的output文件夹下面的humanseg文件夹可以找得到生成后的图像文件

visualization = True)

imshow(img, result[0]['s*e_path'], True)[2025-03-29 22:53:15,620] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the object

<Figure size 840x700 with 2 Axes>

换背景

参数说明

backgroundImg: 输入背景图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。

s*eImg: 合成后图片保存的路径和文件名

其余参数保持不变即可。

In [8]下面代码运行时间大概需要 1-3 秒左右

from PIL import Image

from displayimg import imshow

%matplotlib inline

backgroundImg = "work/beijing.jpg" # <-背景图片路径s*eImg = './output/background_replace_output.png' # <- 图片合成后的保存路径humanImg = result[0]['s*e_path']

backgroundImg = Image.open(backgroundImg).convert('RGBA')

humanImg = Image.open(humanImg).convert('RGBA')

resultImg = Image.new("RGBA", backgroundImg.size)

resultImg = Image.alpha_composite(resultImg, backgroundImg)

resultImg = Image.alpha_composite(resultImg, humanImg)

resultImg.s*e(s*eImg)

imshow(result[0]['s*e_path'], s*eImg, True)<Figure size 840x700 with 2 Axes>

以上就是【NCDA】手把手教你用AI玩转图像的详细内容,更多请关注其它相关文章!

# ai

# 百度

# red

# deepl

# udio

# fig

# 右键

# 该文件

# 请耐心

# 拖拽

# 栏上

# 变量值

# 替换成

# 手把手

# 美图

# 玩转

# 网站排名优化 专治周o斯技术高

# 贵阳小语种网站建设

# 金阳青花椒的营销与推广

# 潞城如何优化网站

# 英行联盟营销推广策划案

# fb营销推广哪里好做

# 免费网络推广seo

# 福田公司网站建设公司

# 上海搜索关键词排名痛点

# 网站优化到底难不难学呀